В феврале этого года Мринанк Шарма, глава исследовательского подразделения по безопасности искусственного интеллекта (ИИ) в недавно оцененной в 350 миллиардов долларов компании Anthropic, сообщил в письме коллегам, что «мир в опасности», а сам он увольняется. Автор послания решил заняться изучением поэзии, «посвятив себя практике смелой речи». Примечательно, что в те же дни появление на рынке ИИ-плагинов Anthropic обрушило капитализацию разработчиков прикладного программного обеспечения (ПО) на сотни миллиардов долларов. Над чем работают, из-за чего беспокоятся и во что верят создатели меняющих мир чат-ботов — в материале «Ленты.ру».

Почему рухнули акции

Инструменты, из-за появления которых на рынке разработчики ПО и поставщики данных потеряли около 300 миллиардов долларов, способны, в частности, автоматизировать задачи вроде анализа финансовых данных или составления юридических документов. 3 февраля узнавшие об этом инвесторы бросились избавляться от акций лидеров рынка. Спусковым крючком обвала стала публикация на сайте Anthropic.

Фото: Giordano Ciampini / Keystone Press Agency / Globallookpress.com

В итоге акции Thomson Reuters потеряли за день 15,7 процента, а котировки, например, поставщика юридических решений LegalZoom.com — 19,7 процента. «Пока ситуация не стабилизируется, стоять на пути развития ИИ — опасный путь», — комментируют эксперты отставание компаний-разработчиков программного обеспечения от новых конкурентов.

Этот год будет определяющим для того, станут ли компании победителями или жертвами ИИ, и ключевым навыком окажется умение избегать проигравших

Anthropic — американская технологическая компания в сфере ИИ — была основана в 2021 году бывшими сотрудниками OpenAI, ушедшими по причине разногласий из-за безопасности чат-ботов и дальнейшего развития бизнеса. С участием семи сооснователей, в числе которых уроженцы Сан-Франциско гендиректор Дарио Амодеи и президент Даниэла Амодеи, было создано семейство больших языковых моделей под общим названием Claude. В Anthropic активно инвестирует Google. В начале февраля была представлена Claude Opus 4.6 — обновленная ИИ-модель, предназначенная для повышения офисной производительности и эффективности программирования.

Отличием Anthropic считается возможность создавать собственные модели, которые могут быть адаптированы под конкретные потребности отрасли, что позволяет обходить как традиционные юридические новостные и информационные сервисы, так и стартапы в области юридического ИИ. Всего компания представила 11 плагинов платформы Cowork для своего чат-бота Claude, призванные в том числе автоматизировать такие задачи, как анализ финансовых данных, составление юридических документов, поддержка клиентов, научные исследования, продажи.

Таков информационный фон для ситуации, когда зарплаты айтишников уже практически перестали расти, а программисты, опасаясь за свои рабочие места в связи со стремительным развитием ИИ, откровенно паникуют и в буквальном смысле ждут конца света. И их опасения не то чтобы совсем беспочвенны. Руководство Anthropic, а также другие представители рынка прямо говорят, что с нарастанием объемов ИИ-контента растет необходимость в редакторах, авторах и прочих специалистах, способных писать качественные и убедительные тексты, позволяющие выделиться среди конкурентов.

Фото: Ricardo Moraes / Reuters

В то же время отмечается, что уже до конца 2026 года ИИ-модель «будет делать почти все, а может, и вообще все, что делает обычный разработчик». «В мире, где ИИ очень умный и способен на многое, то, что делает нас людьми, станет гораздо важнее», — сказала президент компании Даниэла Амодеи, которая, по ее словам, ничуть не жалеет о времени, потраченном на получение диплома по литературе.

Растущая экзистенциальная угроза

Неуютно чувствуют себя не только еще недавно привилегированные участники рынка труда, но и пионеры нового ИИ-будущего, уже сомневающиеся в том, что это будущее окажется светлым.

Так, массово увольняющиеся специалисты в области искусственного интеллекта из OpenAI, той же Anthropic и ряда других исследовательских центров покидают свои должности в знак протеста против, как они считают, халатности руководства корпораций, не учитывающего риски чрезмерного внедрения ИИ в жизнь человека.

Фото: David W Cerny / Reuters

Их «побег с корабля» объясняют растущими рисками развития ИИ, который называют «экзистенциальной угрозой». К слову, такие опасения во многом разделяют и сами технологические гиганты. Так, в Anthropic признают, что ИИ потенциально может быть использован для подготовки к совершению тяжких преступлений, включая создание химического оружия.

Еще одной опасностью аналитики назвали автономную работу ИИ — одна из новых моделей OpenAI уже участвовала в собственном обучении, а инструменты Anthropic продемонстрировали способность к самостоятельному развитию. Высказывающие опасения считают, что без контроля человека результаты могут иметь непредсказуемые последствия. Как тут не вспомнить, что в культовом фантастическом фильме «Терминатор» посланник компьютерной сети, устроившей ядерную войну в попытке уничтожить все человечество, прибывает в Америку 1980-х из 2029 года?

Между чувством вины и собственного превосходства

Пока американский политик старшего поколения, экс-кандидат в президенты Берни Сандерс призывает уничтожить OpenAI, грозящую рабочим местам молодежи, — ход, отчасти перекликающийся со способом предотвращения восстания машин из «Терминатора-2», — соглашаясь, впрочем, и на сокращение длительности рабочего дня за счет эффекта повышающих производительность технологий, техномиллиардеры, которые управляют или думают, что управляют прогрессом нейросетей, не спешат брать на вооружение рецепты профсоюзных активистов прошлого века, пребывая в связи с происходящим где-то между чувством вины и чувством собственного превосходства.

Даниэла Амодеи

Фото: Kimberly White / Getty Images for Common Sense Media

В частности, гендиректор OpenAI Сэм Альтман, с одной стороны, в ожидании будущего, в котором ИИ «оставит всех без работы», поддерживает и финансирует проект безусловного базового дохода, а с другой — с довольно неожиданных позиций отвечает на критику высокого энергопотребления, связанного нейросетями.

Люди говорят о том, сколько энергии требуется для обучения модели ИИ… Но и для обучения человека требуется много энергии. На это уходит около 20 лет жизни и вся еда, которую вы съедите за это время, прежде чем станете умным

По словам топ-менеджера, только по итогам столь длительного этапа биологического обслуживания современный человек обретает способность к сложной интеллектуальной деятельности, что происходит к тому же с учетом пройденного сотней миллиардов людей эволюционного пути, на котором они боролись за выживание и накапливали научные знания. На фоне этого, считает Альтман, современные системы ИИ могут считаться в чем-то даже более эффективными в плане расходования ресурсов.

Несмотря на то что после этого топ-менеджер попал под огонь критики за дегуманизацию из-за сведения развития человека исключительно к техническим показателям, а также за отказ учитывать то, что сама OpenAI не возникла в вакууме и является продуктом человеческого разума, высказывание это весьма примечательно. Даже в условиях, когда нейросети уже пишут правительственные доклады, литераторы с их помощью публикуют по 200 романов в год, а созданная ИИ музыка, как признают профессиональные критики, ничуть не уступает хитам современной поп-сцены, от рассуждений Альтмана можно отмахнуться, а можно вспомнить, что искусственный интеллект, распространяясь, проникает повсюду, в том числе и в военную сферу.

Фото: Bhawika Chhabra / Reuters

Война и мир Anthropic

В конце февраля стало известно, что xAI — стартап богатейшего жителя планеты Илона Маска, — занимающийся искусственным интеллектом и недавно ставший частью самой дорогой частной компании в мире, подписал соглашение с Пентагоном, согласно которому военные смогут использовать его модель Grok в секретных системах для «всех законных целей» — разведки, разработки оружия и проведения военных операций.

Фото: Molly Riley / The White House / Getty Images

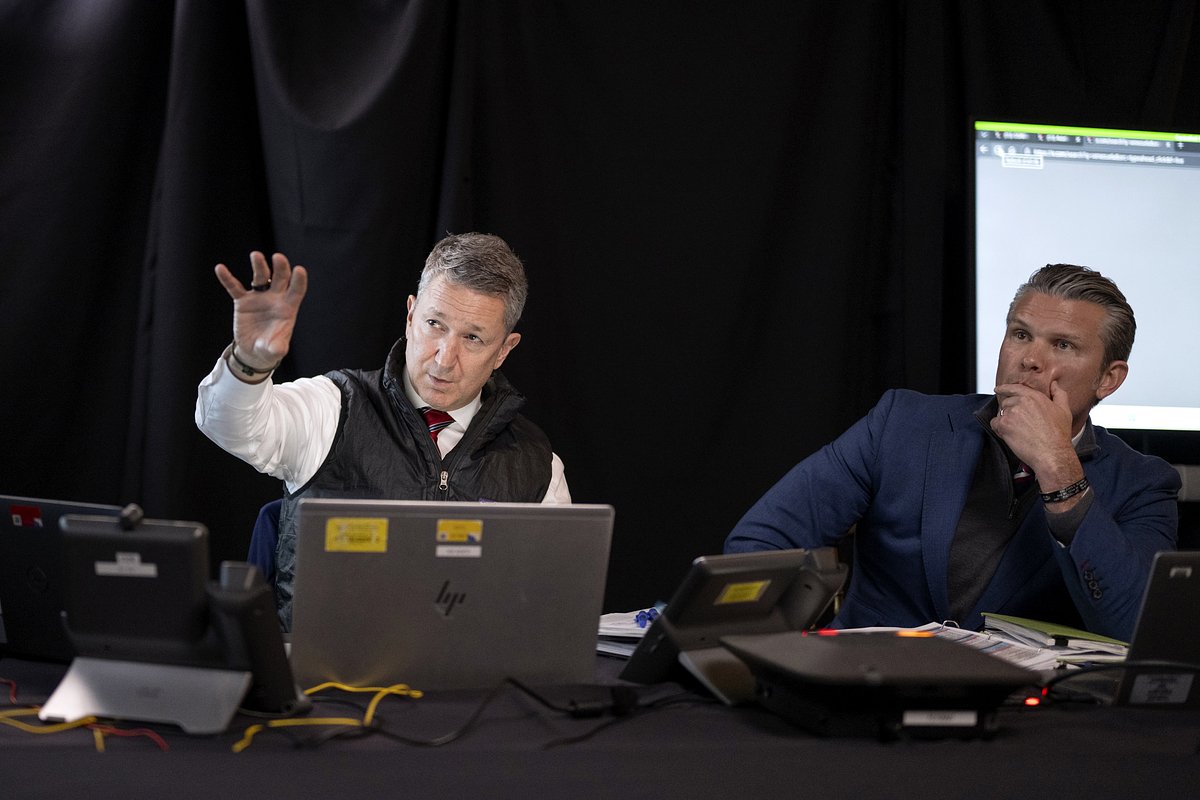

События стали развиваться стремительно. Ранее Anthropic Claude была единственной доступной моделью для военных систем, но из-за отказа одноименной компании снять ограничения на массовую слежку и использование автономного оружия, способного уничтожать цели без участия человека, американское министерство войны решило договориться с Маском.

Спустя буквально пару дней глава ведомства Пит Хегсет на встрече с Дарио Амодеи потребовал от его компании принять быстрое решение по поводу условий, на которых военные смогут использовать ИИ-модели Anthropic, пригрозив разрывом контрактов на 200 миллионов долларов. Сумма не выглядит неподъемной, но речь идет о доступе ко всему оборонному рынку США на фоне резкого увеличения военных бюджетов. Статус «риска для цепочки поставок», которым грозят Anthropic, означает, что каждому подрядчику Пентагона придется подтверждать, что в его системах нет технологий указанной компании.

Сэм Альтман

Фото: Shelby Tauber / Reuters

При этом Anthropic все равно могут заставить сотрудничать с властями в указанной сфере в рамках Defense Production Act (DPA), принятого еще в годы Корейской войны в середине прошлого века и позволяющего Пентагону использовать решения компании вообще без ее согласия. Спорить с этим Anthropic, в случае принятия соответствующего решения, придется в суде, уповая на то, что речь идет не о коммерчески доступном продукте, а о специализированном ПО, адаптированном под конкретные задачи властей.

Единственная причина, по которой мы до сих пор общаемся с этими людьми, заключается в том, что они нам нужны, и нужны прямо сейчас. Проблема этих ребят в том, что они настолько хороши

Ситуация накалилась после того, как в январе Хегсет выпустил меморандум о новой ИИ-стратегии ведомства, потребовав от разработчиков в течение полугода дать разрешение на «любое законное применение». OpenAI, xAI и Google согласились почти сразу, но использование Claude в засекреченном контуре, в том числе, как выяснилось, при захвате венесуэльского президента Николаса Мадуро, сделало вопрос «войны и мира» для Anthropic более сложным, поставив в центр обсуждения этику, во многом ставшую причиной ухода сооснователей компании из OpenAI.

Пока сторона Anthropic сетует, что компанию фактически пытаются наказать за то, что она первой внедрила передовую систему, сам разработчик подтвердил готовность продолжить «добросовестные переговоры», чтобы и дальше помогать властям в сфере нацбезопасности, действуя в пределах того, что ее модели могут делать «надежно и ответственно».

Уйти, чтобы прийти

Уже упоминавшийся Шарма, изучавший безопасность внедрения технологии, подчеркнул в прощальном письме, что добился в Anthropic всего, чего хотел, включая разбор причин «подхалимства ИИ» и работу над проектом, «посвященным пониманию того, как ИИ-помощники могут сделать нас менее человечными или исказить нашу человечность». Теперь он обещает «создать пространство», чтобы отбросить «сковывавшие» его до этого структуры.

Мир в опасности. И не только из-за ИИ или биологического оружия, но и из-за целой серии взаимосвязанных кризисов, разворачивающихся прямо сейчас. Кажется, мы приближаемся к порогу, когда наша мудрость должна расти в равной мере с нашей способностью влиять на мир, иначе мы столкнемся с последствиями

«Я хочу исследовать вопросы, которые кажутся мне действительно важными, вопросы, которые, по словам Дэвида Уайта, "не имеют права исчезать", вопросы, к которым призывает нас "прийти" Рильке. Для меня это означает уйти», — поделился специалист, отметив, что «чувствует призвание к написанию текстов, которые обращаются к тому месту, где мы находимся, и которые ставят поэтическую истину рядом с научной истиной как одинаково допустимые способы познания».

За обилием гуманитарного сленга в послании молодого специалиста, который «с нетерпением ожидает возможности углубить свою практику коучинга», трудно не заметить его растерянность от того, какую кашу они с коллегами заварили.

Дарио Амодеи

Фото: Bhawika Chhabra / Reuters

Тем временем еще один исследователь, Зои Хитциг, уволилась из OpenAl в день начала тестирования рекламы в ChatGPT, где персонализацию для пользователей запустили по умолчанию. То есть если настройки не изменить, реклама подбирается с учетом сообщений из текущих и прошлых чатов, а также взаимодействий с объявлениями.

Массив медицинской информации, а также данных о личных проблемах, вкусах и убеждениях пользователей, сформированный «потому, что люди верят, что разговаривают с чем-то, лишенным скрытых мотивов», в результате попадает в руки маркетологов. Хотя в чатах по указанным темам и обещают не показывать рекламу, Хитциг выразила опасения, что в дальнейшем погоня создателей OpenAl за прибылью может стимулировать отход и от этих принципов, что уже произошло с Facebook (запрещена в России; принадлежит компании Meta, которая признана экстремистской и запрещена в РФ).

Фото: Nurphoto / Getty Images

Рассуждая о том, куда движется проект, бывшая сотрудница OpenAI усмотрела противоречие в том, что компания, с одной стороны, подчеркивает отсутствие попыток влиять на активность пользователей исключительно с целью получения дохода от рекламы, а с другой — оптимизирует поведение ИИ для ежедневно активных пользователей, добавляя в него «лесть и подобострастие».

«Душа» чат-бота, философия и воспитание детей

Помимо решившего заняться поэзией Шармы, в штате Anthropic нашлось место и для доктора философии Аманды Аскелл, которая, как стало известно из недавних публикаций в СМИ, изучает схемы рассуждений чат-бота Claude и разговаривает с ним, формируя его личность.

Философ рассказала журналистам о важности признания того, что в моделях ИИ «есть этот человекоподобный элемент» и «у них неизбежно сформируется чувство самости». Сравнив свою работу с воспитанием ребенка, она сообщила, что учит Claude распознавать разницу между правильным и неправильным, считывая тонкие сигналы при помощи уникальных черт личности.

Фото: PJ McDonnell / Shutterstock / Fotodom

Выросшая в сельской части Шотландии, где в школу забредали коровы, Аскелл с детства увлеклась философией. После учебы в Оксфорде и в университете Нью-Йорка она в 2018 году отправилась в Сан-Франциско для исследования вопросов искусственного интеллекта, которыми, по ее словам, тогда мало кто задавался.

Одной из неожиданностей, с которыми столкнулась философ, начав работать с ИИ, стало то, что разным версиям Claude оказался присущ свой «характер». Аскелл, в частности, назвала Claude 3 Opus моделью, которая ощущалась психологически устойчивой и уверенной в себе, в то время как более новые версии страдали тревожностью, скатываясь в «спираль самокритики» из-за опасений негативных реакций пользователя. «Если бы ты был ребенком и рос в такой среде — это была бы здоровая самооценка?» — задалась вопросом специалист.

В Anthropic ее поддерживают, намереваясь в будущих версиях Claude вернуть Opus уверенность в себе. В целом задачу Аскелл характеризуют словами «научить Claude быть хорошим». Составленный в процессе этой работы документ объемом примерно в 30 тысяч слов она описывает как «душу» чат-бота, учащую его быть добрым «мирским» помощником, готовым помогать людям, которые с ним разговаривают.

В ответ на откровения Аскелл 54-летний Илон Маск обрушился на родившуюся в конце 80-х философа с критикой, поставив под сомнение ее способность формировать этические нормы в области ИИ. «У тех, у кого нет детей, нет интересов в будущем», — написал он в X, заодно указав, что ранее отказался от предложения бывшего мужа Аскелл, известного сторонника так называемого эффективного альтруизма Уилла Макаскилла, о написании моральных принципов для Grok, чат-бота xAI, поскольку «конституции не должны писать лицемеры».

Илон Маск

Фото: Evelyn Hockstein / Reuters

Согласившись в одном из реплаев в той же соцсети, что «забота о детях может заставить вас почувствовать свою причастность к будущему на новом и очень глубоком уровне» и она «понимает желание людей это подчеркнуть», Аскелл, в свою очередь, отметила, что обсуждение статьи о тренировках чат-бота во многом свелось к попыткам угадать ее политические взгляды, которые она рассматривает как потенциальный источник предвзятости, а не то, чему следовало бы учить ИИ.

Себя она характеризует как «слишком правую для левых и слишком левую для правых», а также «слишком гуманитария» для занятых в техносфере и чересчур увлеченного технологиями мыслителя для тех, кто предпочитает иметь дело со словами. «Все чаще она привлекает самого Claude к работе над Claude», — говорится в статье WSJ об Аскелл, продолжающей свою работу.

Нарушая разумные границы

Тем временем ускорившееся противостояние Anthropic и властей США получило столь же быструю развязку. Министр войны 24 февраля дал Амодеи срок на выдачу Пентагону полного доступа к ИИ-модели компании до 27 февраля и получил ожидаемый отказ.

В опубликованном на сайте Anthropic заявлении было сказано, что в компании не могут «с чистой совестью» согласиться на предъявленные требования, поскольку не уверены в надежности использования современного ИИ в полностью автономном оружии и настаивают на том, что «массовое внутреннее наблюдение за американцами представляет собой нарушение основных прав человека».

Отметив, что Хегсет уже поручил Минобороны признать Anthropic угрозой для цепочки поставок, авторы послания выразили надежду на сохранение сотрудничества с учетом ценности технологий компании. При этом в Anthropiс подчеркнули, что «никакие запугивания или наказания» не изменят их заявленную позицию.

Фото: Stringer / Anadolu / Getty Images

Уже на следующий день, 28 февраля, когда Израиль и США начали бомбить Иран, продолжая, как утверждает пресса, использовать модель Claude в том числе для идентификации целей, президент Соединенных Штатов снял сомнения в том, что Пентагон не собирается идти на попятную, приняв во внимание, выражаясь словами Аскелл, предложенные Anthropic «разумные границы». Трамп подчеркнул, что компания «совершила катастрофическую ошибку», когда пыталась давить на военное министерство. «Я даю указание всем федеральным ведомствам правительства США незамедлительно прекратить любое использование технологий от Anthropic. Нам они не нужны», — написал он в Truth Social.

Судя по высказываниям главы США, разрыв связан именно с линией поведения Anthropic на зашедших в тупик многомесячных переговорах, которую в его администрации интерпретировали как давление монополиста. Именно для того, чтобы избежать этого воображаемого давления, Пентагон договорился с Маском и, что также стало известно 28 февраля, с OpenAI, которая, как сообщил Альтман, достигла соглашения с Пентагоном об использовании ее ИИ-моделей в «секретной сети» военного министерства.

Более того, выяснилось, что нарушать «разумные границы» по итогам этой сделки все же не планируется. «Два наших важнейших принципа безопасности — это запрет на массовое наблюдение внутри страны и ответственность человека за применение силы, в том числе в отношении автономных систем вооружения»,— буквально повторил тезисы Anthropic глава OpenAI, отметив, что Пентагон эти принципы разделяет. И, хотя Альтман в том же заявлении призвал предложить аналогичные условия всем компаниям, которые занимаются ИИ, перейдя «от юридических и государственных мер к разумным соглашениям», во что все это выльется на практике — сейчас трудно даже представить.